[जनरल एम.एम. नरवणे (रिटायर्ड) का यह आलेख इंडिया टुडे मैगजीन के 17 जनवरी 2024 के अंक में प्रकाशित हुआ था ]

जून 2023 में अमेरिकी कांग्रेस के संयुक्त सत्र को संबोधित करते हुए प्रधानमंत्री नरेंद्र मोदी ने कहा था कि भविष्य AI है- आर्टिफिशियल इंटेलिजेंस और अमेरिका इंडिया. अक्टूबर 2023 में नई दिल्ली में हुई USIFP (यूएस-इंडिया स्ट्रैटिजक पार्टनरशिप फोरम) की बैठक में चेयरमैन एमेरिटस जॉन चैंबर्स और सीईओ डॉ. मुकेश आघी दोनों ने ही भारत-अमेरिकी रिश्तों में AI की अहमियत पर जोर दिया. सरकारी हलकों से लेकर बोर्डरूमों तक AI की गूंज सारी दुनिया में है.

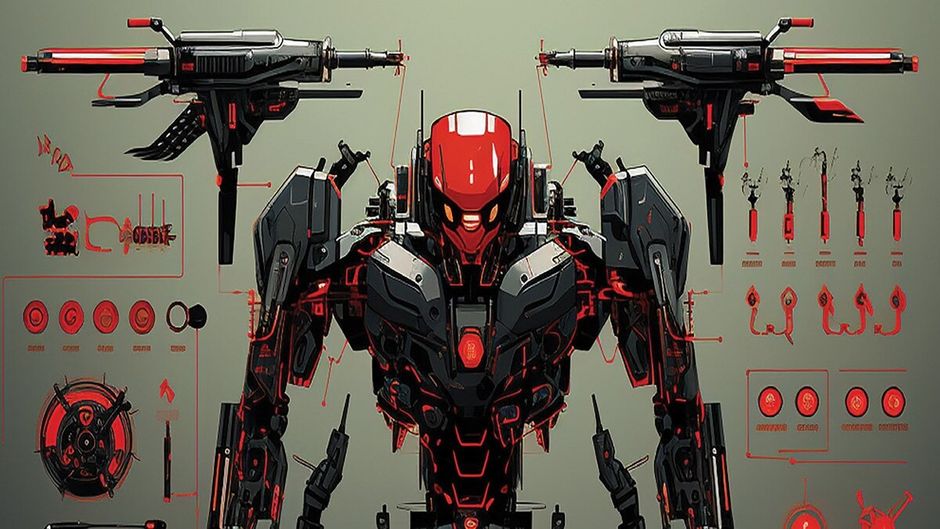

हमारी जिंदगी के हरेक पहलू में दाखिल होकर यह 21वीं सदी के लिए वही होने जा रहा है जो सिलिकन चिप्स पिछली सदी के लिए थीं. रक्षा क्षेत्र में AI काफी समय से चर्चा का विषय रहा है. इसमें युद्ध के तौर-तरीकों को जबरदस्त ढंग से बदल देने की क्षमता है- प्रशिक्षण और निगरानी से लेकर लॉजिस्टिक्स, साइबर सुरक्षा, यूएवी, लीथल ऑटोनोमस वेपन सिस्टम या घातक स्वायत्त शस्त्र प्रणाली सरीखे उन्नत सैन्य हथियारों, स्वायत्त लड़ाकू वाहनों और रोबोट तक.

AI की शक्ति से संचालित सैन्य उपकरण विशाल मात्रा में डेटा को संभाल सकते हैं जिससे सशस्त्र बलों के लिए फैसले लेना कहीं ज्यादा आसान हो सकता है.

हालांकि सेना में AI का इस्तेमाल खासा जोखिम भरा भी है, क्योंकि इसके जरिए मानव हस्तक्षेप के बगैर चलाए जा सकने वाले स्वायत्त हथियार विकसित किए जा सकते हैं. ऐसे हथियारों के इस्तेमाल के गैर-इरादतन नतीजे हो सकते हैं और इंसानी जिंदगी के लिए खतरा पैदा हो सकता है. सेना में AI का इस्तेमाल दोधारी तलवार है. यह पक्का करना बहुत जरूरी है कि इसका इस्तेमाल जिम्मेदारी से हो.

AI आधारित हथियार विकसित करने पर नियम-कायदे लागू किए जाने चाहिए ताकि मानव जीवन को खतरा न हो. साइबर सुरक्षा के क्षेत्र में भी AI वरदान भी है और अभिशाप भी. AI साइबर हमलों का पता लगा सकता है और उन्हें रोक सकता है, पर हमलावर भी इसका इस्तेमाल पहचाने जाने से बचने और ज्यादा गंभीर हमले करने के लिए कर सकते हैं. सैन्य प्रणालियों की तरह साइबर सुरक्षा में AI आधारित सॉल्यूशंस को भी इस्तेमाल करने वालों की हिफाजत करनी चाहिए. इसके अलावा साइबर हमलों और खासकर सेंसर-शूटर लिंक तथा हथियार प्लेटफॉर्म को रोकना चाहिए.

सेना में AI के इस्तेमाल से कई फायदे हो सकते हैं:

● फैसले लेने में मदद: AI से संचालित सैन्य उपकरण विशाल मात्रा में डेटा संभाल सकते हैं और सशस्त्र बलों के लिए बेहतर फैसले लेना ज्यादा आसान बना सकते हैं.

● बेहतर निगरानी: AI का इस्तेमाल करके उन्नत निगरानी और जासूसी प्रणालियां विकसित की जा सकती हैं जो दुश्मन की आवाजाही और हलचलों का पता लगाकर उनका पीछा कर सकती हैं.

● लॉजिस्टिक में सुधार: यह लॉजिस्टिक और सप्लाइ चेन प्रबंधन को सटीक कर सकता है ताकि सही वक्त और सही जगह पर सही संसाधन पक्के तौर पर मिल सकें.

● स्वचालित वाहन: AI का इस्तेमाल ऑटोनॉमस लड़ाकू वाहन और ड्रोन बनाने के लिए हो सकता है जिससे मानव जीवन को खतरा कम होगा.

● साइबर सुरक्षा: इसका इस्तेमाल साइबर हमलों का पता लगाने और रोकने के लिए किया जा सकता है, जिससे संवेदनशील सैन्य जानकारी की रक्षा पक्की हो सके.

● प्रशिक्षण में सुधार: AI का इस्तेमाल ऐसी उन्नत प्रशिक्षण प्रणालियां विकसित करने के लिए किया जा सकता है जो असली परिस्थितियों की नकल तैयार कर सकें, जिससे सैनिक सुरक्षित और नियंत्रित माहौल में प्रशिक्षण हासिल कर सकेंगे.

इनमें से ज्यादातर फायदे, जैसे फैसले लेने में मदद, लॉजिस्टिक्स, प्रशिक्षण और साइबर सुरक्षा जीवन के ज्यादातर क्षेत्रों में बराबर से लागू किए जा सकते हैं. AI का इस्तेमाल जब लीथल काइनेटिक सिस्टम में किया जाता है, तो मुद्दा ज्यादा पेचीदा हो जाता है. इन हथियार प्रणालियों का संचालन नैतिक सिद्धांतों और मूल्यों के अनुरूप करना सुनिश्चित करते समय नैतिक मुद्दे सामने आएंगे.

हालांकि ये मूल्य क्या होने चाहिए, यह भी अभी तय किया जाना है और ये हर देश के लिए अलग हो सकते हैं. यह भी इतना ही परेशान करने वाला मुद्दा है कि घातक प्रणालियों को पूरी तरह स्वायत्त होना चाहिए या इंसान का उनसे जुड़ाव होना चाहिए. पूरी तरह बदला जा सकने वाला विशुद्ध प्रबंधकीय फैसला तो देखरेख के बगैर लिया जा सकता है, लेकिन दुश्मन के निशाने पर मिसाइल दागना पूरी तरह अलग मामला है. अगर इसका इस्तेमाल खालिस रक्षात्मक रूप में किया जा रहा हो, आने वाली मिसाइलों को मार गिराने के लिए, जैसे इजरायल का आयरन डोम करता है, तब तो स्वायत्त और AI का इस्तेमाल स्वीकार्य हो सकता है.

अलबत्ता मानव लक्ष्यों के खिलाफ इसके इस्तेमाल पर बहुत ज्यादा सोच-विचार करना होगा. AI फूलप्रूफ या दोषरहित नहीं है और इसमें जानबूझकर या अनायास ही किसी तरह का पूर्वाग्रह अपनाया गया है तो यह घातक हो सकता है. नौकरियों या हेल्थकेयर के लिए कंपनियों की ओर से इस्तेमाल AI आधारित एल्गोरिद्म से जेंडर, नस्ल और यहां तक कि लहजे पर आधारित पूर्वाग्रहों का स्पष्ट पता चला है.

सैन्य AI में अनजाने में भी पूर्वाग्रहों का आ जाना विनाशकारी हो सकता है. यही नहीं, हम अब भी उस अवस्था में नहीं पहुंचे हैं जहां सहानुभूति और करुणा जैसी मानवीय भावनाओं को शामिल कर पाएं. AI का प्रयोग सैन्य प्रणालियों में होगा और होना चाहिए, खासकर अगर इससे अगल-बगल होने वाला नुकसान कम और टकराव की अवधि छोटी होती हो.

मगर फिर अगल-बगल का कितना नुकसान स्वीकार्य है, इसकी अपने-अपने ढंग से व्याख्या की जा सकती है, जैसा कि गजा की लड़ाई में सामने आया. सैन्य इस्तेमाल के लिए AI के विकास के साथ इसके प्रयोग की देखरेख के लिए कुछ वैसी ही अंतरराष्ट्रीय संधि की जरूरत है जैसी कतिपय पारंपरिक हथियारों के संदर्भ में है. ऐसी संधि में प्रमुख प्रावधान यह होना चाहिए कि इससे एक ऐसे इंसान का जुड़ा होना अनिवार्य हो जो आखिरी फैसले की नैतिक जिम्मेदारी ले.

'स्टॉप किलर रोबोट्सट' कैंपेन AI समर्थित हथियार प्रणालियों को दी गई स्वतंत्रता की सीमा तय करने की मांग करके ठीक ही करने की कोशिश कर रहा है. भारत सशस्त्र बलों में AI को लाने के लिए अहम कदम उठा रहा है. मगर इसका इस्तेमाल नैतिकता और जिम्मेदारी से किया जाना चाहिए. आखिरकार मनुष्य की जान लेना एल्गोरिद्म पर नहीं छोड़ा जा सकता.