- रेनी डिरेस्टा

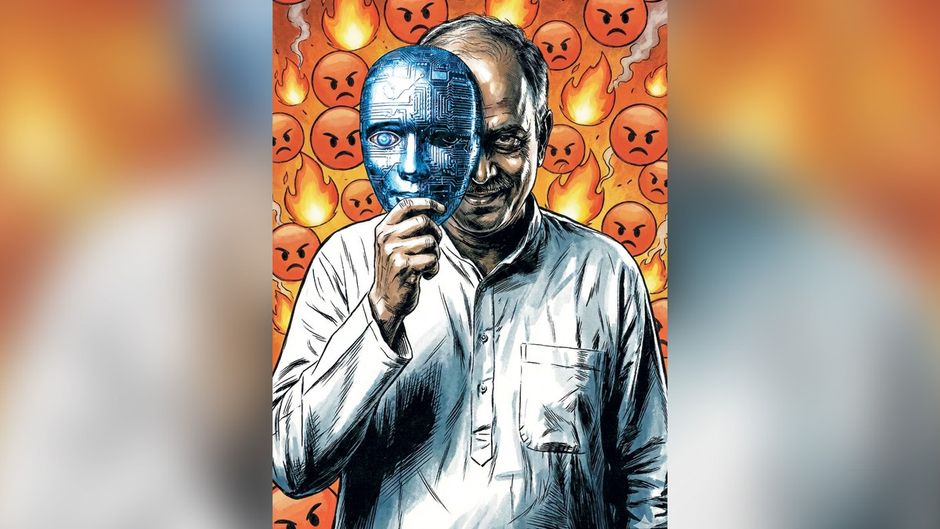

भारत में 2024 के आम चुनाव में दो महीनों के दौरान कथित तौर पर 5 करोड़ से ज्यादा एआइ-से बने वॉयस कॉल प्रसारित किए गए. दिवंगत राजनेताओं को स्क्रीन पर पुनर्जीवित कर उनकी विरासत आगे बढ़ाने के प्रयास किए गए. एक राजनेता चुनाव प्रचार के दौरान चार ऐसी भाषाएं बोलते दिखे जिन्हें वे पढ़ना-लिखना नहीं जानते थे.

इनमें कुछ चीजें लोगों तक पहुंच बढ़ाने के लिए थीं, अभियान 22 भाषाओं में चलाए गए. वहीं कुछ का इस्तेमाल गुमराह करने के लिए किया गया, जैसे प्रधानमंत्री की आलोचना करते एक अभिनेता का नकली कंटेंट. यह तकनीक सही और गलत दोनों चीजों को संभव बनाती है.

2018 से ही विश्लेषक, प्रौद्योगिकीविद् और पत्रकार आगाह कर रहे हैं कि जेनरेटिव एआइ चुनावों की दशा-दिशा बदल देगा, लोगों का भरोसा घटाएगा और सोचे-समझे तरीके से दुष्प्रचार को बढ़ावा देगा. हर अगला चुनाव इस भय को गहरा कर देता है. जब तक सब कुछ खत्म नहीं होता, किसी अनिष्ट की आशंका रहना स्वाभाविक प्रतिक्रिया है! शायद डीपफेक और बॉट बस हो-हल्ला हों.

लेकिन दोनों ही प्रतिक्रियाएं मूल मुद्दे से भटक रही हैं. क्योंकि अहम बात यह नहीं कि तकनीक खुद में कोई मायने रखती है बल्कि वह तो सूचना तंत्र है जिसमें यह तकनीक काम करती है.

डीपफेक को लेकर 2018 से ही एक आशंका कायम रही है कि ''दुरुपयोग का फायदा'' मिलता है, यदि विश्वसनीय मनगढ़ंत सामग्री मौजूद हो तो वास्तविक साक्ष्य को भी नकली बताकर खारिज किया जा सकता है. 2020 तक, जब मुझे और स्टैनफोर्ड इंटरनेट ऑब्जर्वेटरी में मेरे सहयोगियों को जीपीटी-3 की प्रारंभिक पहुंच मिली तभी स्पष्ट हो गया था कि नई तकनीक दुष्प्रचार के लिए कितना बड़ा हथियार साबित हो सकती है. कई तरह की भाषाओं की नकल करके, बड़ी मात्रा में सस्ती प्रचार सामग्री तैयार की जा सकती है. 2022 में हमने जोखिम घटाने के तरीकों के बारे में लिखना शुरू किया; दूसरे लोगों ने भी ऐसा ही किया. 2024 तक एआइ कंपनियों ने नियमित रूप से यह खुलासा करना शुरू कर दिया कि गलत इरादा रखने वाले तत्व उनके टूल्स इस्तेमाल कर रहे हैं.

तो फिर हम अब तक उसी चर्चा में क्यों उलझे हुए हैं और खुद को इसके लिए तैयार क्यों नहीं पा रहे? क्योंकि हम इसे तकनीकी समस्या मान रहे हैं जबकि यह भरोसे से जुड़ी समस्या है और हमने उन अंतर्निहित स्थितियों में बदलाव के लिए खास कुछ नहीं किया है जो कृत्रिम मीडिया को खतरनाक बनाती हैं.

डीपफेक ऐसे सूचना परिवेश में गंभीर खतरा बनकर उभरा है, जिसे सोशल मीडिया ने पिछले 15 वर्षों में बुरी तरह चोट पहुंचाई है. प्लेटफॉर्म यूजर्स को ध्रुवीकृत कर देते हैं. एल्गोरिद्म आक्रोश, नौटंकी और गुटबाजी को बढ़ावा देते हैं. नतीजतन, हम तक उसी तरह की जानकारी पहुंच पाती है, जो हम देखना चाहते हैं. संस्थागत विश्वसनीयता पूरी तरह खत्म हो गई है और जनता के बड़े हिस्से ने यह मान लिया है कि जो सामग्री उन्हें असहज करती है, वह फेक है. इससे उस जगह एक शून्यता उत्पन्न हो गई है, जहां पहले कोई विश्वसनीय प्राधिकारी हुआ करता था और एक मध्यस्थ की भूमिका निभा सकती थी, जिसकी बात को दोनों ही पक्ष सही मानते थे मसलन फैक्ट चेकर, पत्रकार या सरकारी एजेंसियां. अब एक पक्ष जिसे विश्वसनीय जानकारी मानता है, दूसरा उसे सिरे से नकार देता है.

जेनरेटिव एआइ एक तरह से इस आग को हवा देता है. झूठ से हुआ फायदा बताता है कि अविश्वास कैसे काम करता है. 2023 में तमिलनाडु में द्रमुक नेता के भ्रष्टाचार के आरोपों वाले ऑडियो क्लिप सामने आए. उन्होंने इन्हें बेबुनियाद बताया और कहा कि इन्हें छेड़छाड़ करके बनाया गया है. इनकी स्वतंत्र स्तर पर फोरेंसिक जांच कराई तो निष्कर्ष निकला कि एक क्लिप संभवत: प्रामाणिक थी लेकिन दूसरी में शोर इतना अधिक था कि उसके बारे में निर्णायक तौर पर कुछ कहा नहीं जा सकता और संभवत: उसमें छेड़छाड़ की गई हो. ऐसे मामलों में तकनीक खंडन में सहायक बन जाती है. हालांकि, यह तभी कारगर साबित होता है जब सामने वाला विश्वास (या अविश्वास) करना तय कर चुका होता है. वे ऐसे समूहों में बंटे होते हैं जहां पसंद न आने वाले साक्ष्यों को भी पूरी सहजता से खारिज कर दिया जाता है.

यह स्थिति आगे और गहराएगी. जब तक फोरेंसिक विश्लेषक किसी विश्वसनीय सनसनीखेज वीडियो के नकली होने की पुष्टि करते हैं, तब तक वह एन्क्रिप्टेड मैसेजिंग ऐप्स के माध्यम से वायरल हो चुका होता है और मतदाताओं को प्रभावित कर चुका होता है, ऐसा खासकर मतदान शुरू होने से ऐन पहले वाले समय में किया जाता है. जेनरेटिव टूल्स लगातार उन्नत होते जा रहे हैं जबकि सही-गलत में अंतर करने वाली तकनीक अभी खासी पीछे हैं. असर में भी असमानता है: हमलावर को एक बार कामयाब होना है जबकि बचाव करने वालों को सब कुछ पकड़ना होता है.

बहरहाल, खतरे को उसके वास्तविक परिप्रेक्ष्य में देखना जरूरी है: भारत की डीपफेक विश्लेषण इकाई ने बताया कि 2024 के चुनाव में सामने आए डीपफेक में बहुत कम असली थे. ज्यादातर घटिया दर्जे की हेरफेर कर बनाई सामग्री थी. जनरेटिव एआइ से डीपफेक बनाने की लागत लगभग शून्य है, फिर भी सोशल मीडिया प्लेटफॉर्म पर इसे आसानी से वायरल नहीं किया जा सकता क्योंकि इसमें एल्गोरिद्म, इन्फ्लुएंसर्स और ऑनलाइन दर्शकों को संयोजित करने की जरूरत होती है. नकली डीपफेक अक्सर फ्लॉप होते हैं क्योंकि लक्षित दर्शक उन्हें आकर्षक नहीं पाते.

लेबलिंग एक ऐसी नीतिगत प्रतिक्रिया है जिसे कई सरकारें अपना रही हैं लेकिन इसकी गूढ़ सीमाएं समझना महत्वपूर्ण है. व्यापक नियम एआइ से संपादित सेल्फी, किसी काल्पनिक यूनिकॉर्न की छवि और किसी राजनेता की झूठे तरीके से फंसाने के लिए खींची गई तस्वीर पर भी समान रूप से लागू होते हैं. लेबलिंग के प्रति लापरवाह रवैया अपनाना वास्तविक समस्या है: जैसे, कैलिफोर्निया में व्यवसायों को किसी भी उत्पाद में कैंसर कारक रसायनों के बारे में सूचना देना अनिवार्य है; ये सूचनाएं अब इतनी आम हो गई हैं कि कोई इन पर ध्यान नहीं देता.

अगर अनुपालन ठीक से न किया जाए तो नतीजे उल्टे साबित हो सकते हैं. इसे ऐसे समझ सकते हैं कि यदि सिंथेटिक सामग्री कभी-कभार ही चिन्हित की गई तो देखने वाले बिना चिन्हित सामग्री को भी प्रामाणिक मान लेंगे, भले ही उस पर गलती से लेबलिंग न हो पाई हो. यही नहीं लेबल केवल वहीं दिखाई देते हैं जहां प्लेटफॉर्म उन्हें लगा सकते हैं: व्हाट्सऐप ग्रुप और एन्क्रिप्टेड चैट में यह मुश्किल है और भारत में राजनैतिक सामग्री अक्सर इन्हीं पर ज्यादा प्रसारित होती है. लेबलिंग पारदर्शिता का ठोस उपाय है लेकिन एकमात्र सुरक्षा कवच नहीं है जैसा लोग चाहते हैं.

यूजर्स को सामग्री की प्रामाणिकता जांचने के लिए टूल और सूचना हेल्पलाइन उपलब्ध कराना भविष्य में और भी महत्वपूर्ण हो जाएगा. भारत में ऑल्ट न्यूज और बूम लाइव जैसे फैक्ट चेकिंग संगठन भ्रामक जानकारियों का खंडन प्रकाशित करते हैं. मिसइन्फॉर्मेशन कॉम्बैट एलायंस एक व्हाट्सऐप सूचना हेल्पलाइन चलाता है जिस पर कोई भी संदिग्ध सामग्री को फोरेंसिक विश्लेषण के लिए भेज सकता है. 'विटनेस' के डीपफेक रैपिड रिस्पॉन्स फोर्स जैसे अंतरराष्ट्रीय नेटवर्क स्थानीय पत्रकारों को फोरेंसिक विशेषज्ञों के साथ जोड़ते हैं; इसने ही तमिलनाडु के ऑडियो क्लिप की पुष्टि में मदद की. ये प्रयास कारगर तो हैं पर संसाधनों की कमी से जूझ रहे हैं.

अमेरिका आज दुनिया के लिए एक चेतावनी भरा सबक बन चुका है. पहले जिन संस्थाओं ने समन्वित दुष्प्रचार अभियानों का पर्दाफाश किया था, अब खतरा और गंभीर होने के बीच उन्हें खत्म किया जा चुका है. असल बात यह है कि इस चुनौती से निबटने के लिए धन और इच्छाशक्ति का अभाव है.

भारत ने कम से कम उस क्षेत्र में शुरुआत तो की है जिसे कई लोकतंत्र नजरअंदाज कर चुके हैं और यह है मानदंड स्थापित करने की पहल. मई 2024 में चुनाव आयोग की तरफ से जारी दिशा-निर्देश में राजनैतिक दलों से चुनाव प्रचार में डीपफेक का इस्तेमाल न करने की सलाह दी गई. यही नहीं, डीपफेक ऑडियो या वीडियो का पता चलने के कुछ घंटों के भीतर उसे हटाने और जिम्मेदार लोगों को चेतावनी देने का निर्देश भी दिया गया. हालांकि, यह कोई पुख्ता इलाज नहीं है लेकिन यह महत्वपूर्ण जरूर है: सोशल मीडिया एक चीज है और सामाजिक मानदंड दूसरी.

संस्थाओं को अपनी विश्वसनीयता बनाए रखनी होगी, ताकि आधिकारिक स्रोत अफवाहों पर विराम लगाने में सक्षम हो सकें. जेनरेटिव एआइ के जरिए होने वाली हेरफेर को गहराई से समझने के लिए मीडिया साक्षरता एक जागरूक लोकतांत्रिक समाज के लिए महत्वपूर्ण है. इस समस्या के अध्ययन के लिए भारतीय सामाजिक वैज्ञानिकों और प्रौद्योगिकीविदों को वित्तीय मदद की जानी चाहिए; विशेषज्ञता स्थानीय स्तर पर विकसित की जानी चाहिए और एक निरंतर प्रक्रिया का हिस्सा होनी चाहिए. साथ ही, इसे बड़े टेक प्लेटफॉर्म से स्वतंत्र रखना चाहिए क्योंकि उनके अपने कई निहित स्वार्थ भी होते हैं.

कोई भी नया चुनाव हर बार एआइ से पैदा किए गए दुष्प्रचार को लेकर नए सिरे से अंदेशे बढ़ाता है. फिर लोकतांत्रिक व्यवस्था पूरी तरह ध्वस्त न होने पर राहत की सांस ली जाती है, और अगले चुनाव के साथ एक बार फिर उदासीनता घेर लेती है. हमें दो बातें हमेशा अपने ध्यान में रखनी होंगी: डीपफेक सब कुछ खत्म कर देने में सक्षम नहीं, और वह 'बेवजह का शोर' भी नहीं. इस्तेमाल किए जा रहे टूल्स नए हैं, मानदंड कमजोर हैं और अविश्वास बहुत ज्यादा है लेकिन इसका समाधान आशंकाओं में डूबे रहना या अपनी आंखें मूंद लेना भर नहीं है. बल्कि क्षमता और नैतिकता को दृढ़ता से स्थापित करके ही इससे निबटा जा सकता है.

खास बातें

समस्या तकनीक नहीं बल्कि एल्गोरिद्म के सहयोग से बना बंटा हुआ माहौल है जिसमें डीपफेक पहुंच रहा.

''दुरुपयोग का फायदा'' मिलता है: यदि विश्वसनीय मनगढ़ंत सामग्री मौजूद हो तो वास्तविक साक्ष्य को भी नकली बताकर खारिज किया जा सकता है.

समाधान? संस्थाओं की विश्वसनीयता और बड़ी टेक कंपनियों से इतर स्वतंत्र स्थानीय प्लेटफॉर्म में निवेश.

भारत ने कम से कम मानदंड तो स्थापित किए. मई 2024 में चुनाव आयोग ने एडवाइजरी में राजनैतिक दलों से चुनाव प्रचार में डीपफेक का इस्तेमाल न करने की सलाह दी.

(रेनी डिरेस्टा जॉर्जटाउन यूनिवर्सिटी के मैककोर्ट स्कूल ऑफ पब्लिक पॉलिसी में एसोसिएट रिसर्च प्रोफेसर हैं.)