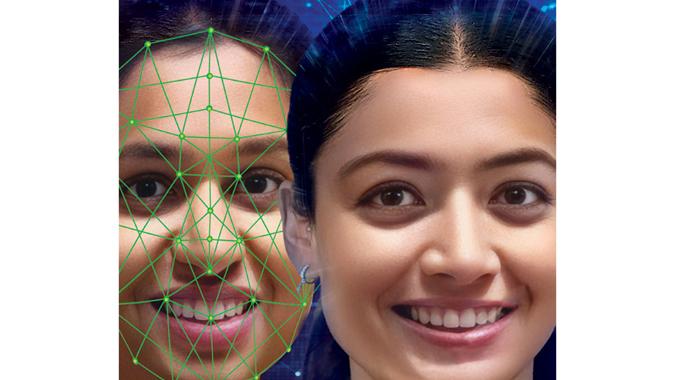

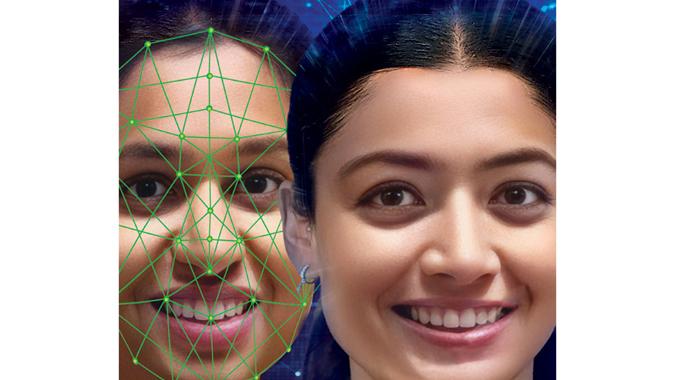

अगली बार आप अपने स्मार्टफोन ऐप पर फॉरवर्ड बटन दबाएं, तो एक पल को ठहरें. जो दिलकश तस्वीर या विचारोत्तेजक वीडियो आप साझा करने जा रहे हैं, बिलाशक असली लग सकता है लेकिन शायद डीपफेक हो. जैसा कि हाल ही में अभिनेत्री रश्मिका मंदाना के साथ हुआ. वायरल वीडियो में आप उन्हें काले रंग की लिबास में एलिवेटर पर कदम बढ़ाते देखते हैं. दरअसल, उनका चेहरा ब्रिटिश-भारतीय इंफ्लूएंसर जारा पटेल के एक वीडियो पर स्वैप कर दिया गया या लगा दिया गया है, जो कुछ हफ्ते पहले ही पोस्ट किया गया था.

साफ-सफाई बेमानी है, वीडियो तो वायरल हो चुका है. अभिनेत्री ने कहा, "यकीनन ऐसा कुछ न सिर्फ मेरे लिए, बल्कि हममें से हरेक के लिए बेहद डरावना है, जो आज टेक्नोलॉजी के दुरुपयोग से आहत हो रहे हैं...अगर स्कूल या कॉलेज में मेरे साथ ऐसा होता, तो मैं सोच भी नहीं पाती कि क्या करूं. इससे पहले कि हममें से ज्यादा लोग ऐसी पहचान की चोरी के शिकार हों, हमें बतौर समुदाय और फौरन इस पर गौर करने की जरूरत है."

अब तक, सिर्फ रश्मिका ही इसका शिकार नहीं हुईं. अभिनेत्री कैटरीना कैफ और काजोल की फेक तस्वीरें दनादन सामने आ गईं, जो डीपफेक के तेजी से पंजे फैलने का संकेत है. एक फैक्ट-चेकर ने रश्मिका की क्लिप को फर्जी बताया, तो 5 नवंबर को एक्स (पहले ट्विटर) पर बिग बी की प्रतिक्रिया आई, "हां, यह पक्का कानूनी मामला है." हालांकि, कुछ ही दिनों बाद अमिताभ बच्चन के अपने क्विज शो कौन बनेगा करोड़पति का एक वीडियो क्लिप घूमने लगा, जो मध्य प्रदेश में चुनाव प्रचार में चल रहा था. इसमें वॉइस डब के साथ छेड़छाड़ की गई थी. चुनावी मौसम में ऐसे कई फर्जी ऑडियो-वीडियो घूमते रहे हैं.

डीपफेक की पैदाइश

चेहरा स्वैप करना या बदलना कोई नया मामला नहीं है. फोटोशॉप जैसा इमेज एडिटिंग सॉफ्टवेयर नब्बे के दशक से मौजूद है, जिससे कोई भी कंप्यूटर जानकार तस्वीरों के साथ छेड़छाड़ कर सकता है. लेकिन 2016 के बाद डीप लर्निंग तकनीक की आमद से नाटकीय बदलाव आ गया. अचानक, अब कंप्यूटर ग्राफिक्स इमेजरी या ऑडियो रिकॉर्डिंग के लिए भारी तामझाम वाले स्टूडियो में बैठे पेशेवरों की जरूरत नहीं रह गई; कोई अपने गैराज में बैठे-बैठे मजे से यह कर सकता है.

आखिर क्या है डीपफेक

आपको बस गेमिंग कंप्यूटर जैसे एक दमदार ग्राफिक्स प्रोसेसिंग यूनिट की जरूरत है. और फिर, काबिल आर्टिफिशियल इंटेलिजेंस (AI) तो कई मशीन लर्निंग मॉडल के जरिए ऑनलाइन उपलब्ध ही है. विजुअल डेटा के मामले में ट्रेंड आज के एआई मॉडल चुटकी बजाते नए विजुअल तैयार कर सकते हैं जिसे असली विजुअल से फर्क कर पाना लगभग मुश्किल है. इसी से अंदाजा लगता है कि डीपफेक वालों के लिए पोर्नोग्राफी चहेता विषय क्यों है.

दरअसल, डीपफेक शब्द की पैदाइश 2017 के अंत में हुई, जब एक यूजर ने इसी नाम से सोशल मीडिया प्लेटफॉर्म रेडिट पर अश्लील वीडियो पोस्ट किया. उसमें गल गडोट, स्कारलेट जोहानसन और टेलर स्विफ्ट जैसी हॉलीवुड हस्तियों के चेहरे पोर्न क्लिप में स्वैप कर दिए गए थे.

लंदन स्थित टेक्नोलॉजी विशेषज्ञ, लेखक तथा स्टार्ट-अप सलाहकार जसप्रीत बिंद्रा कहते हैं, "डीपफेक शर्तिया एआई से जुड़ी बड़ी समस्याओं में एक है." केंद्रीय इलेक्ट्रॉनिक्स और सूचना-प्रौद्योगिकी राज्यमंत्री राजीव चंद्रशेखर ने इंडिया टुडे से बातचीत में कहा, "डीपफेक दरअसल एआई और फर्जी खबरों के धंधेबाजों का घालमेल है, बेशक हम सभी के लिए यह चिंता का विषय है, क्योंकि यह यकीनन व्यक्तियों, समाजों, समुदायों और देशों के लिए बहुत बड़ा खतरा है." अब यह सिर्फ असली और नकली में फर्क करने का मामला नहीं रह गया है. गलत हाथों में पड़ने पर किसी भी असली चीज या दृश्य को खतरनाक ढंग से तोड़मरोड़ कर पेश किया जा सकता है.

कितनी गहरी है समस्या

डीपफेक की आमद के बाद उस टेक्नोलॉजी में तेजी से विकास हुआ है, और उच्च गुणवत्ता वाली डीपफेक सामग्री पर आने वाला खर्च भी काफी घट रहा है. फिल्मी सितारों के अलावा, दुनिया की आला हस्तियों—पोप फ्रांसिस से लेकर पूर्व अमेरिकी राष्ट्रपति बराक ओबामा और डोनाल्ड ट्रंप तक—पर लगातार मीम बन रहे हैं. 17 नवंबर को प्रधानमंत्री नरेंद्र मोदी ने चेताया कि डीपफेक भारी संकट ला सकता है और समाज में 'असंतोष की आग भड़का सकता है.' उन्होंने खुलासा किया कि कैसे उन्होंने हाल ही में खुद को गुजराती 'गरबा' करते एक डीपफेक देखा, जो उन्होंने स्कूल में भी कभी नहीं किया.

वैश्विक परामर्श फर्म केपीएमजी के एक अध्ययन का अनुमान है कि डीपफेक बनाने या उसे पहचानने वाले 1,00,000 से ज्यादा एआई-आधारित मॉडल आ गए हैं. इनमें करीब 3,000 ही 'डीपफेक को ठीक से पहचान' सकते हैं, ज्यादातर सिर्फ अधकचरे फेक को ही पहचान पाते हैं. नीदरलैंड मुख्यालय वाली विजुअल थ्रेट इंटेलिजेंस कंपनी, सेंसिटी.एआई के मुताबिक, 2018 के बाद से ऑनलाइन फर्जी वीडियो की तादाद तेजी से बढ़ रही है, जो लगभग हर छह महीने में दोगुनी हो रही है. फर्म का जोर देकर कहना है कि उसने दिसंबर 2020 तक 85,047 ऑनलाइन फर्जी वीडियो का पता लगाया.

और, यह सिर्फ वीडियो तक ही सीमित नहीं है. 2019 में, एक बहुराष्ट्रीय कंपनी की सहयोगी ब्रिटिश कंपनी से बॉस की आवाज की क्लोनिंग करके 2,43,000 डॉलर की चोरी करने वाले डीपफेक ऑडियो की कहानी सुर्खियां बटोर चुकी है. हाल में, अमेरिका स्थित एक डेटा एनालिटिक्स फर्म न्यू काइट डेटा लैब्स ने दावा किया कि पीएलए (पीपल्स लिबरेशन आर्मी ऑफ चाइना) से करार वाली बीजिंग स्थित एक निजी एआई फर्म स्पीचओशन भारत, खासकर पंजाब और जम्मू-कश्मीर में संवेदनशील सरहदी इलाकों से लोगों के आवाज के नमूने जुटा रही है.

जाहिर तौर पर स्थानीय लोगों को पूर्व-लिखित शब्दों, वाक्यांशों या वार्तालापों को रिकॉर्ड करने के लिए काम पर रखा गया है, जिन्हें बाद में चीन स्थित सर्वर पर डाल दिया जाता है. हालांकि इस डेटा संग्रह के सही मकसद का पता नहीं चल पाया है, लेकिन यह पर्याप्त वजह है कि देश के नीति-निर्माता प्रोपगेंडा के प्रति सचेत हो जाएं. पूर्व राष्ट्रीय साइबर सुरक्षा संयोजक गुलशन राय कहते हैं, "पहले फेक था, अब डीपफेक है."

"डीपफेक राष्ट्रीय सुरक्षा के लिए खतरा है क्योंकि इसके जरिए सामाजिक टकराव पैदा करने और सार्वजनिक शांति को भंग करने की गुंजाइश है. सभी देश इसका इस्तेमाल करना चाहते हैं, इसलिए इसे काबू में रखने में किसी की दिलचस्पी नहीं दिखती. राजनैतिक चुनावों से लेकर युद्धों तक में डीपफेक का इस्तेमाल हर कोई कर रहा है." उन्होंने यह भी कहा कि खासकर युद्ध में रणनीतिक लाभ लेने के लिए प्रोपगेंडा और दुष्प्रचार जैसी रणनीति का इस्तेमाल किया जाता है.

मसलन, जून 2020 में लद्दाख में भारतीय और चीनी सैनिकों के बीच गलवान घाटी में झड़प के बाद मनोवैज्ञानिक दबाव की रणनीति के तहत फर्जी वीडियो चले थे. राय ने कहा, "असल लड़ाई के बिना फर्जी खबरों से युद्ध में निर्णायक बढ़त हासिल की जा सकती है. हम यूक्रेन-रूस युद्ध और अब गजा में जो देख रहे हैं, वह आधुनिक युद्ध की शुरुआत मात्र है."

पिछले साल, जेनरेटिव एआई ने दुनिया में तहलका मचा दिया, क्योंकि यूजरों को ऐसी टेक्नोलॉजी हाथ लग गई, जो सिर्फ टेक्स्ट प्रॉम्प्ट से कविता से लेकर अजीबोगरीब नजारे कुछ भी तैयार कर सकती थी. जेनरेटिव एआई का बाजार 2030 तक 100 अरब डॉलर से अधिक का हो जाने की उम्मीद है, जो सालाना 35 फीसद से अधिक की औसत दर से बढ़ रही है. पिछले साल जेनरेटिव एआई की आमद से डीपफेक को पहचानना और भी बड़ी चुनौती बन गया है.

अमेरिका में रिवरसाइड कैलिफोर्निया विश्वविद्यालय में वीडियो कंप्यूटिंग ग्रुप (VCG) के अगुआ प्रोफेसर अमित रॉय-चौधरी के मुताबिक, यह पहचानना कि कोई तस्वीर असली है या नकली काफी हद तक उसके ब्यौरों का विषय बनता जा रहा है. "जैसे आप कोई तस्वीर या दृश्य देखते हैं और फिर कोई कहता है, 'नहीं, ऐसा तो हुआ ही नहीं." रश्मिका और कैटरीना दोनों के डीपफेक मामले में यही तो हुआ है.

कैसे पता करें डीपफेक

रॉय-चौधरी के कंप्यूटर विजन और मशीन लर्निंग में शोध कार्य में डीपफेक की पहचान करने के तरीके शामिल हैं. वे बताते हैं, "आखिर में कंप्यूटर पर कोई छवि संख्याओं का मैट्रिक्स होती है और आप संख्याओं के उस सेट को देखते हैं, तो उनमें कुछ खासियत होती है. प्राकृतिक छवि में संख्याएं एक निश्चित तरीके से तारतम्य में होती हैं."

इसलिए जब किसी छवि के साथ छेड़छाड़ की जाती है, तो उसकी संख्याएं भी बदल जाती हैं. मसलन, किसी के बाल डिजिटल रूप से बदल दिए गए हैं, तो उसके पिक्सेल सुराग दे सकते हैं. यानी बालों के एक पिक्सेल का मान एक होता है, लेकिन बगल के बाल का मान अलग होता है, भले ही वे दोनों एक ही रंग के हों. वे कहते हैं, "अगर ऐसा कई पिक्सेल पर होता है, तो आप संदेह करना शुरू कर सकते हैं कि ऐसा क्यों हो रहा है. किसी व्यक्ति के बाल स्वाभाविक रूप से इस तरह नहीं बदलते हैं."

वीसीजी ने 2022 में एक नई विधि विकसित की, जिसके बारे में उसका दावा है कि यह मौजूदा अत्याधुनिक तरीकों के मुकाबले अधिक सटीकता के साथ डीपफेक वीडियो में चेहरे के भावों में छेड़छाड़ का पता लगा सकता है. जाहिर है, किसी व्यक्ति के चेहरे के भावों में हेरफेर का पता लगाना यकीनन चेहरे की अदला-बदली का पता लगाने के मुकाबले अधिक कठिन काम है.

हावभाव में बदलाव बहुत सूक्ष्म होते हैं. किसी तरह के हेरफेर का पता लगाने के लिए आपको किसी छवि में अति लघु क्षेत्रों को देखना होगा. वीसीजी की कोशिशें शोधकर्ताओं को दुष्प्रचार या फर्जी सूचना वाले हेरफेर किए गए वीडियो का पता लगाने के लिए स्वचालित उपकरण विकसित करने के करीब ले आई हैं.

भारत में मई 2023 में चेहरे के हावभाव में हेरफेर की मिसाल देखी गई, जो यौन उत्पीड़न की शिकायतों पर कार्रवाई के लिए महिला ओलंपिक पहलवानों के पांच महीने लंबे विरोध प्रदर्शन के बीच एक महत्वपूर्ण मौका था. दिल्ली पुलिस ने प्रदर्शनकारियों को हिरासत में लिया, तो पहलवान विनेश और संगीता फोगाट ने पुलिस वैन में गंभीर मुद्रा में बैठे एक सेल्फी पोस्ट की.

लेकिन दूसरी तस्वीर में दोनों महिला पहलवान मुस्करा रही थीं. पुरानी तस्वीर वायरल हुई. बाद में फर्जी पाई गई. कुछ बॉलीवुड स्टूडियो के साथ काम करने वाली डिजिटल मार्केटिंग एजेंसी व्हाइट रिवर्स मीडिया के सह-संस्थापक तथा सीईओ श्रेणिक गांधी कहते हैं, "बॉलीवुड ही नहीं, बल्कि हर चर्चित व्यक्ति अचानक डीपफेक से भयभीत हो उठा है, जो चारों ओर मौजूद हैं लेकिन एआई की शक्ति के साथ बढ़ गए हैं. सबसे बड़ा मुद्दा यह है कि सकारात्मक बातों के मुकाबले नकारात्मक बातें तेजी से फैलती हैं. कुछ भी नकारात्मक है, तो भले ही सफाई देते रहिए, वह काम नहीं आता है. हम इसको वायरल होने से कैसे रोक सकते हैं?"

डीपफेक का मुकाबला

यह सिर्फ डीपफेक नहीं है, जिसकी वजह से हर तरफ कोहराम मच जाए. 2012 की घटना याद कीजिए जब एसएमएस पर नफरत-भरे संदेशों की बाढ़ आ गई थी और इससे घबराकर हजारों की संख्या में लोग बेंगलूरू जैसे दक्षिणी शहरों से पूर्वोत्तर राज्यों में अपने गृहनगरों की ओर लौटने को बाध्य हुए. डीपफेक नई तकनीक का एक उत्पाद है, मगर इस सारी समस्या से जुड़ा एक दूसरा पहलू भी है. वह है सोशल नेटवर्क की असीमित पहुंच, जिससे ये पलक झपकते वायरल हो जाते हैं.

केंद्रीय इलेक्ट्रॉनिक्स और सूचना-प्रौद्योगिकी राज्यमंत्री चंद्रशेखर के मुताबिक, सरकार की तरफ से फरवरी 2021, अक्तूबर 2022 और फिर अप्रैल 2023 में सूचना-प्रौद्योगिकी कानून के नियमों में संशोधन इन्हीं नई चुनौतियों को ध्यान में रखकर किए गए. इसका उद्देश्य यह तय करना था कि सोशल मीडिया प्लेटफॉर्म अनिवार्य तौर पर आश्वस्त करेंगी कि उनके प्लेटफॉर्म पर उपलब्ध सूचना गलत नहीं है.

इंडिया टुडे से बातचीत में उन्होंने कहा, "अब आइटी नियमों के साथ हम कह रहे हैं कि सुरक्षा कवच (सोशल मीडिया कंपनियों के लिए किया गया प्रावधान) सशर्त है और शर्त यह है कि 11 तरह का कंटेंट उनके प्लेटफॉर्म पर मौजूद नहीं होना चाहिए." प्रतिबंधित कंटेंट में 'अपमानजनक, अश्लील, पोर्नोग्राफिक, और बच्चों से जुड़ी आपत्तिजनक सामग्री' के अलावा 'जानबूझकर या किसी खास इरादे के साथ ऐसी कोई जानकारी प्रसारित करना भी शामिल है जो गलत या भ्रामक प्रकृति की हो लेकिन तथ्यात्मक तौर पर सही नजर आती हो.'

7 नवंबर को चंद्रशेखर की तरफ से सभी सोशल मीडिया प्लेटफॉर्म के लिए एक सख्त संदेश जारी किया गया, जिसमें उन्हें हरसंभव उपयुक्त कदम उठाने की सलाह के साथ डीपफेक की सूचना के 36 घंटों के भीतर हटाने को कहा गया. साथ ही चेताया गया कि प्लेटफॉर्म इसके अनुपालन में नाकाम रहते हैं तो सूचना-प्रौद्योगिकी कानून, 2000 की धारा 79 के तहत मिली सुरक्षा गंवा देंगे.

सेफ हार्बर कहलाने वाला ये प्रावधान दरअसल सोशल मीडिया प्लेटफॉर्म को थर्ड पार्टी की तरफ से प्रेषित किसी सूचना, डेटा या कम्युनिकेशन लिंक को लेकर किसी भी तरह के कानूनी दायित्व से बचाता है. चंद्रशेखर कहते हैं, "अगर वे ऐसा नहीं करते हैं तो कानूनी कार्रवाई से मिला संरक्षण गंवा देंगे और जो भी पीड़ित है, वह उन्हें कोर्ट में घसीट सकता है. उन पर आइपीसी की धारा और आइटी कानून के तहत आपराधिक मुकदमा भी चलाया जा सकता है."

इन कानूनों के प्रावधानों के उल्लंघन का दोषी पाए जाने पर सोशल मीडिया प्लेटफॉर्मों को पांच साल तक जेल और जुर्माने का भी सामना करना पड़ सकता है. आने वाले हफ्तों में इलेक्ट्रॉनिक्स और सूचना-प्रौद्योगिकी मंत्रालय सोशल मीडिया प्लेटफॉर्मों के साथ मिलकर काम करेगा ताकि यह तय हो सके कि "हमें स्पष्ट तौर पर पता है कि कौन-सी तकनीक, कौन-से टूल इस्तेमाल किए जाएंगे और जवाबदेही का नियामक ढांचा कैसा होगा." सरकार प्रस्तावित डिजिटल इंडिया कानून में डीपफेक से निबटने के लिए कड़े प्रावधान शामिल करने की भी योजना बना रही है. नए कानून पर अभी चर्चा चल रही है और यह जल्द ही आइटी कानून, 2000 की जगह लेगा.

वैश्विक स्तर पर गूगल व मेटा जैसी प्रौद्योगिकी कंपनियों ने पिछले कुछ महीनों में डीपफेक से निबटने के लिए विभिन्न कदम उठाने की घोषणा कर रखी है. फोटोशॉप युग की तरह वॉटरमार्क का इस्तेमाल करना उन्हीं में से एक उपाय है.

मसलन, गूगल ने अगस्त में बताया था कि उसका सिंथआइडी टूल सीधे तौर पर इमेज के पिक्सेल में एक डिजिटल वॉटरमार्क एम्बेड कर देता है, जो सामान्य तौर पर तो नजर नहीं आएगा लेकिन इसके जरिये असली-नकली का पता लगाया जा सकता है. और कंपनी के नए टेक्स्ट-टू-इमेज मॉडल इमेजन के यूजर्स के लिए यह फिलहाल बीटा परीक्षण के दौर में है. कंपनी अपने ऑडियो जेनरेशन फ्रेमवर्क ऑडियोएलएम में सिंथेटिक ऑडियो का पता लगाने वाले टूल पर भी काम कर रही है.

दूसरा, यह भी तय किया जाना है कि विज्ञापनदाता, खासकर राजनैतिक कंटेंट देने वाले, यह बताएं कि उनके विज्ञापनों को डिजिटली कब बदला गया या उनमें सिंथेटिक कंटेंट शामिल है. गूगल की अपडेट 'पॉलिटिकल कंटेंट' पॉलिसी नवंबर में ही लागू हो जाएगी, वहीं मेटा की ऐसी ही नीति जनवरी में अमल में आएगी.

अब, जरा इस तरह के स्व-नियामक तंत्र की तात्कालिक आवश्यकता पर गौर करें, तो भारत और अमेरिका में 2024 में चुनाव प्रस्तावित हैं और फिर एक साल बाद ब्रिटेन में आम चुनाव होंगे. अर्जेंटीना में हालिया चुनावों में राष्ट्रपति पद के दो उक्वमीदवारों सर्जियो मस्सा और जेवियर माइली ने अपने अभियानों में जमकर एआई-आधारित पोस्टर और वीडियो इस्तेमाल किए थे. दक्षिण अमेरिकी राष्ट्र का चुनाव पहली बार डीपफेक के व्यापक इस्तेमाल का एक बड़ा उदाहरण है.

मनोरंजन और संगीत क्षेत्र से जुड़े अधिकारों की कानूनी विशेषज्ञ प्रियंका खिमानी कहती है, "आम तौर पर एक गलत धारणा है कि कानून तेजी से बदलती प्रौद्योगिकी के साथ कदमताल नहीं करते हैं." ए.आर. रहमान, शंकर-एहसान-लॉय और लता मंगेशकर एस्टेट के मामले देख रहीं खिमानी कहती हैं, ''दीवानी और आपराधिक दोनों ही स्तर पर पर्याप्त कानूनी समाधान उपलब्ध हैं.

कोई डीपफेक वीडियो वायरल हो रहा है, तो आप साइबर सेल में एफआइआर दर्ज करा सकते हैं. वे आइपी एड्रेस ट्रैक करने और यह पता लगाने में आपकी सहायता करेंगे कि इसे कहां से बनाया गया है. यह कोर्ट जाने और मुकदमा दायर करने से बेहतर उपाय है." बहरहाल, इसके लिए जरूरी है कि कानून पर अमल करने वाले अधिकारी शीघ्र कार्रवाई के लिए तत्पर हों. वे बताती हैं, डीपफेक से पहले भी मशहूर हस्तियां कॉपीराइट और पहचान संबंधी अधिकारों की चुनौती से जूझती रही हैं.

अभिनेता अनिल कपूर ने हाल ही में अपने व्यक्तित्व से जुड़े अधिकारों के अनधिकृत इस्तेमाल के खिलाफ कानूनी लड़ाई जीती है. उन्होंने वैराइटी पत्रिका को बताया, "मेरा इरादा अपने वैयक्तिक अधिकारों की सुरक्षा करना और व्यावसायिक लाभ के लिए किसी तरह के दुरुपयोग को रोकना था, खासकर जब टेक्नोलॉजी और एआई के क्षेत्र में तेजी से बदलाव हो रहे हैं. बात सिर्फ मेरी नहीं है. मेरे परिवार को मेरे अधिकारों की रक्षा करने और भविष्य में उसके लाभ का हक होना चाहिए."

हालांकि, खिमानी कहती हैं कि डीपफेक पोर्न जैसे मामलों में सिर्फ कानूनी फरमान जैसे उपायों से काम नहीं चलने वाला है. वे कहती हैं, "हम अभी पूरी गंभीरता से यह आकलन भी नहीं कर पा रहे हैं कि इस तरह की चीजों का, न कि किसी हाइ-प्रोफाइल व्यक्ति, बल्कि आम लोगों खासकर महिलाओं के खिलाफ किस हद तक दुरुपयोग किया जा सकता है.

मुझे लगता है कि इससे तो पोर्न उद्योग ही पूरी तरह बदल सकता है." वे कहती हैं, "दुनियाभर में जॉन डो आदेश (जिसमें किसी व्यक्ति या इकाई को अज्ञात प्रतिवादी या प्रतिवादियों के खिलाफ कानूनी कार्रवाई की अनुमति होती है) के नाम पर काल्पनिक कार्रवाई बढ़ती जा रही है, मुझे नहीं लगता कि यह कोई ठोस उपाय है. इसे किसके खिलाफ लागू करेंगे? लोगों को उन नतीजों और दंडों के बारे में कैसे पता चलेगा, जो उन्हें भुगतने पड़ सकते हैं?"

तकनीकी विशेषज्ञ बिंद्रा का मानना है कि ऐसी कोई जादू की छड़ी नहीं है, जिससे डीपफेक की समस्या पलक झपकते हल हो जाए. वे कहते हैं, "यह स्थिति लगातार बनी रहने वाली है, जैसा हमने ऐंटीवायरस को लेकर देखा." दरअसल, वे इंटरनेट बूम के तुरंत बाद के वर्षों में मालवेयर सॉफ्टवेयर से निबटने के लिए बड़ी संख्या में ऐंटीवायरस कंपनियों के उभरने का जिक्र कर रहे थे.

बिंद्रा का मानना है कि डीपफेक से निबटने के लिए अब इसी तरह के स्टार्ट-अप का पूरा इकोसिस्टम विकसित हो सकता है. हालांकि, वे कहते हैं कि टेक्नोलॉजी समाधान का एक पहलू भर है. पहली जरूरत तो यही है कि सोशल नेटवर्क डीपफेक के खात्मे के लिए अधिक सक्रिय हों, सख्त कानूनों के साथ नियामक ढांचे को भी मजबूत किया जाए.

इसका दीर्घकालिक समाधान हासिल करने से जुड़ा एक अन्य अहम पहलू है—शिक्षा. बिंद्रा कहते हैं, "हमारी शिक्षा प्रणाली को युवाओं के स्तर पर इससे निबटने के अनुरूप ढालना होगा." साथ ही वे बताते हैं कि कैसे फिनलैंड इस मोर्चे पर शुरुआती कदम उठाने वाले देशों में एक है.

सूचना साक्षरता को 2016 में अपने स्कूल पाठ्यक्रम का हिस्सा बनाना वाला उत्तरी यूरोप का यह देश फेक न्यूज से निबटने की क्षमता और सत्य सामने आने के बाद के प्रभाव के आकलन के लिए गैर-लाभकारी ओपन सोसाइटी इंस्टीट्यूट, सोफिया की तरफ से 2022 में संकलित मीडिया साक्षरता सूचकांक में 41 यूरोपीय देशों में पहले स्थान पर है. ऐसे में यही कहा जा सकता है कि नई पीढ़ी को सजग बनाने से बेहतर कुछ नहीं हो सकता.